Deepfakes zijn geen science fiction meer. In 2023 betaalde een financieel medewerker in Hongkong 25 miljoen dollar aan een oplichter dankzij deepfake-technologie na een videogesprek met een nagebootste CEO. Voor Nederlandse ondernemers is dit geen ver-van-mijn-bedshow: deepfake-technologie wordt steeds toegankelijker en de risico’s nemen toe.

Wat zijn deepfakes precies?

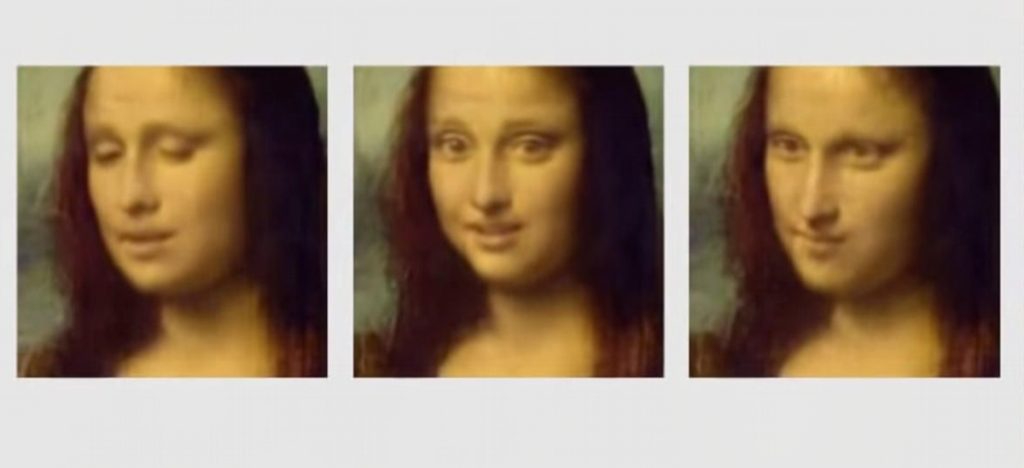

Een deepfake is een video of geluidsopname die door een algoritme is bewerkt, waardoor het lijkt alsof iemand iets heeft gezegd of gedaan wat nooit in werkelijkheid is gebeurd. De naam komt van “deep learning” en “fake” – kunstmatige intelligentie die hyperrealistische, maar volledig vervalste content creëert.

Voor ondernemers manifesteert dit zich vooral als:

- Nagebootste CEO’s of directeuren die frauduleuze betalingsopdrachten geven

- Valse audio-opnames van zakenpartners

- Gemanipuleerde videoconferenties tijdens belangrijke deals

- Nepnieuws met gezichten van bedrijfsleiders

De bedrijfsrisico’s

Deepfakes zijn niet meer te herkennen en tegelijk steeds eenvoudiger om te maken. Dit creëert concrete bedreigingen:

Financiële fraude: Oplichters gebruiken deepfake-video’s of audio van leidinggevenden om betalingen goed te keuren of vertrouwelijke informatie te verkrijgen. Een mkb-bedrijf kreeg bijvoorbeeld een voicemail van een ‘klant’ met een gewijzigde betaalinstructie, ingesproken door een AI-gegenereerde stem.

Reputatieschade: Nepvideo’s van bedrijfsleiders kunnen uw merk in minuten beschadigen, met langdurige gevolgen voor klantenvertrouwen.

Operationele ontwrichting: Medewerkers die niet weten wat echt is, kunnen hun werk niet effectief uitvoeren.

Juridische gevolgen: Een groot deel van de online deepfakes betreft nog steeds ongewenste of potentieel strafbare inhoud, zoals nepvideo’s met seksuele of lasterlijke bedoelingen. Ook zakelijke deepfakes kunnen juridische consequenties hebben, bijvoorbeeld bij misleiding of reputatieschade.

Hoe AI deepfakes detecteert

Moderne detectiesoftware gebruikt verschillende AI-technieken om nepmateriaal te herkennen:

Gezichtsanalyse: Algoritmes gebruiken gezichtsherkenning en temporele consistentie-analyse om onnatuurlijke bewegingen of inconsistenties te detecteren.

Audio-analyse: Detectie van onregelmatigheden in spraakpatronen, ademhaling en achtergrondgeluiden die wijzen op kunstmatige generatie.

Technische metagegevens: Analyse van bestandsstructuren en compressiepatronen die typisch zijn voor AI-gegenereerde content.

Multi-model benadering: Platforms zoals Reality Defender gebruiken probabilistische detectie zonder afhankelijkheid van watermerken, waardoor ze effectiever zijn tegen geavanceerde deepfakes.

Praktische detectietools voor ondernemers

Enterprise-oplossingen:

- Sensity AI biedt een cross-industry platform voor bedrijven, van KYC-leveranciers tot verzekeraars

- DuckDuckGoose AI analyseert video’s, afbeeldingen, stemmen en teksten met duidelijke uitleg van gedetecteerde manipulaties

- Sentinel is een cloud-gebaseerde oplossing met real-time detectie en hoge nauwkeurigheid

Kostenstructuur: Prijzen variëren van $24 per maand tot $216 voor teams, afhankelijk van functionaliteit en volume.

Integratiemogelijkheden: Veel tools bieden integratie met videoplatforms, sociale media en content moderatiesystemen.

Wat u nu kunt doen

Stap 1: Bewustwording creëren Train uw medewerkers om deepfakes te herkennen. Let op inconsistenties in gezichtsuitdrukkingen, onnatuurlijke oogbewegingen of audio dat niet perfect synchroniseert.

Stap 2: Verificatieprotocollen Implementeer dubbele verificatie voor belangrijke beslissingen. Bij verdachte video- of audiocommunicatie altijd terugbellen via een bekend nummer.

Stap 3: Technische maatregelen Overweeg detectiesoftware als onderdeel van uw cybersecuritystrategie, vooral als uw bedrijf regelmatig met video-communicatie werkt of gevoelig is voor reputatieschade.

Stap 4: Juridische voorbereiding Zorg dat uw juridische team bekend is met deepfake-wetgeving en maak duidelijke procedures voor het melden van incidenten.

De toekomst

Deepfake-technologie evolueert snel, maar detectie-AI houdt gelijke tred. Nieuwe ontwikkelingen omvatten real-time detectie in callcenters en geïntegreerde bescherming in communicatieplatforms.

Bedrijven die nu investeren in detectietools en interne procedures, voorkomen niet alleen dure fouten, maar laten ook aan klanten en partners zien dat ze digitale veiligheid serieus nemen. In een tijd waarin beelden steeds minder betrouwbaar zijn, wordt digitale integriteit een onderscheidende factor.